電力,不是成本,是 AI 時代的控制權

AI 電力需求不是短期現象,而是 Jevons Paradox 的極致版本。晶片越進步、場景越多、耗電越大。資本正從追晶片移往追電力——誰有電,誰才能用 GPU。

- AI 電力需求是結構性的,不是循環性的——Jevons Paradox 確保效率提升只會帶來更多用電,而非更少

- 電力可取得性已取代土地與網路,成為 Data Center 選址的第一限制條件

- 資本正從第一階段(追晶片)移往第二階段(追支撐晶片運作的能源與電網基礎設施)

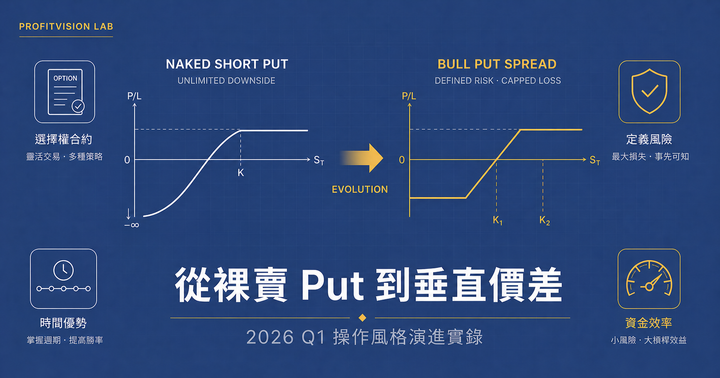

- 電力標的的波動來自市場情緒而非基本面崩壞,天然符合選擇權賣方策略的三個進場條件

- 這個論點有明確的失效條件:估值過高、模型效率突破、景氣衰退砍資本支出——認識邊界,才能正確使用框架

市場最危險的誤判

晶片工藝持續進步,功耗每一代下降,直覺上很多人得出這樣的結論:

這個誤判在工業時代成立。但 AI 時代有一個根本性的不同:它不是在用更少的資源做一樣的事,而是在不斷開拓新的使用場景。

Jevons Paradox:效率提升為何反而耗電更多?

1865 年,英國經濟學家 William Stanley Jevons 在研究蒸汽機時發現:當蒸汽機效率大幅提升,煤炭的使用量不降反升。原因是效率降低了使用成本,反而刺激了更廣泛的應用,讓整體消耗量增加。

這個現象在 AI 時代正在重演,而且規模更大。

- NVIDIA H100 的能源效率比前一代 A100 提升約 3 倍,但全球 GPU 集群的總耗電量仍在加速成長

- GPT-3 訓練耗電約 1,287 MWh;GPT-4 訓練估計超過 50,000 MWh,成長超過 38 倍

- 一次 ChatGPT 查詢的耗電量約為 Google 搜尋的 10 倍;全球每日 ChatGPT 查詢量已突破 1 億次

- IEA 預測:2026 年全球 Data Center 用電量將達到 1,000 TWh,相當於日本全國用電量

晶片越進步,模型就越大、使用場景越多、查詢頻率越高。結果不是用更少電做同樣的事,而是:

AI 不是科技產品,是新型基礎設施

如果你還把 AI 當成「科技股」在看,你正在用一個過期的框架評估一個基礎設施問題。

AI 的本質是計算力基礎設施(Compute Infrastructure),而這個基礎設施有一個無法繞過的物理限制:電力。

更關鍵的是,AI 的電力需求是雙層結構:

- 訓練(Training)——極端高耗能,每次訓練大型模型消耗相當於數百個家庭一年的用電量

- 推論(Inference)——長期持續消耗,每一次查詢、每一次生成,都需要算力支撐

訓練是尖峰,推論是底盤。當 AI 滲透到全產業——金融風控、醫療診斷、製造自動化——推論的電力需求將成為永久性的基礎負荷,而不是間歇性的需求。

- 微軟、Google、Meta、Amazon 四家科技巨頭 2024 年資本支出合計超過 2,000 億美元,其中大部分流向 Data Center 建設

- 一座超大型 Data Center(Hyperscale)的用電量達 100–500 MW,相當於 10–50 萬戶家庭

- 微軟已與 Constellation Energy 簽署 20 年核電 PPA,重啟三哩島核電廠專供 AI 運算

- Google 2024 年宣布 PPA 總容量突破 10 GW,是全球企業中最大的再生能源採購方

電力為何成為 AI 的真正瓶頸?

當市場還在討論「誰有最強的 GPU」時,競爭的底層邏輯已經轉移:

這帶來三個具體的結構性變化:

一、Data Center 選址的第一標準從網路變成電力

過去 Data Center 選址看土地成本和網路連線品質,現在新增了一個否決性條件:電力可取得性(Power Availability)。維吉尼亞州北部(全球最大 Data Center 集群)已出現新電力申請等待期超過 5 年的情況,直接限制了新增算力的部署速度。

二、長約(PPA)從成本工具變成戰略資產

Power Purchase Agreement——提前鎖定 10–20 年電力供應的長期合約——正在成為科技巨頭的核心戰略動作。這不是為了省電費,而是為了確保算力擴張不被電力供應卡住。對電力公司而言,這意味著現金流高度確定;對科技公司而言,這是算力增長的門票。

三、電網本身成為最後一道瓶頸

發電量增加不等於電力可用。輸配電(Transmission & Distribution)才是最後一道卡關。美國電網的平均設備年齡超過 40 年,而 Data Center 集中部署在特定地區,造成局部電網超載。這也是為什麼電網升級相關標的正在被重新定價。

資本流向的三個層次

市場目前處於第一階段——追逐晶片(NVIDIA、AMD)。但第二階段正在展開:追逐支撐晶片運作的基礎設施。資本將流向三個方向:

電力供應

電網升級

能源燃料

為什麼這條主線天然適合賣方策略?

不是所有看好的標的都適合直接買入。電力與電網類標的有三個特性,讓它們天然契合選擇權賣方策略:

這個論點在什麼條件下會失效?

一個誠實的分析,必須說清楚自己在哪裡可能是錯的。以下兩個反方論點有真實的歷史依據,我認真對待它們。

套到 AI 電力:電力公用事業股 2023–2024 年漲幅已達 50–100%。如果 AI 應用滲透速度低於預期,或者出現類似 DeepSeek R1 這種讓推論效率跳躍式提升的技術突破,電力需求成長曲線放緩,目前的估值就難以支撐。

但估值風險是真實的。這個框架的適用前提是:在合理估值或回檔時布局,而不是在已經充分定價之後追入。賣方策略的優勢正在這裡——你不需要在最高點判斷,而是等市場因情緒修正、IV 上升時再出手。

需求端:AI 推論(Inference)已經深入企業核心流程,這部分的電力需求不會因為景氣放緩而歸零,就像雲端服務在 2020 年疫情衝擊下依然成長。真正有風險的是訓練端(大型模型訓練)的資本支出,這確實會在衰退時被推遲。

股價端:衰退期間電力公用事業股會跌,這是確定的。但這不是論點失效,而是買點出現。問題不是「這個趨勢會不會發生」,而是「你在什麼估值和時機介入」。用賣方策略在衰退期把履約價設在合理支撐下方,正是應對這個風險最直接的方式。

這個框架的明確失效條件

以下任一情境發生,這篇文章的核心論點需要重新評估:

認識這些邊界,不是在否定這篇文章的論點,而是讓你知道在什麼條件下這個框架仍然有效,在什麼條件下需要暫停或調整倉位。這才是真正的風險管理思維。

最終結論:你問錯了問題

市場的注意力集中在一個錯誤的問題上:

「晶片會不會越來越省電?」

這個問題的答案是肯定的,但它完全沒有意義。

真正的問題是:

「AI 會不會讓人類用掉更多電?」

歷史已經給出了答案。蒸汽機效率提升之後,英國的煤炭消耗量不降反升。汽車引擎效率提升之後,全球石油消耗量持續擴張。每一次技術效率革命,最終的結果都是消耗總量的爆炸性成長,而不是節約。

AI 是這個規律最新的一次演出,而且規模更大,速度更快。

電力不是短期需求,而是 AI 時代的底層資產。

晶片決定誰跑得快,但電力決定誰能上場。

下一個被重新定價的,不是 AI,而是支撐 AI 運作的整個能源與電網系統。

市場從追晶片到追電力的輪動,不是趨勢,而是邏輯的必然。

你現在看到的,只是這個輪動的起點。

免責聲明:本文所有內容僅供研究與學習參考,不構成投資建議。文中提及之個股或 ETF 僅為說明論點之用,不代表任何買賣建議。投資人應依據自身風險胃納、財務狀況與投資目標,自行判斷並承擔相應風險。

Comments ()