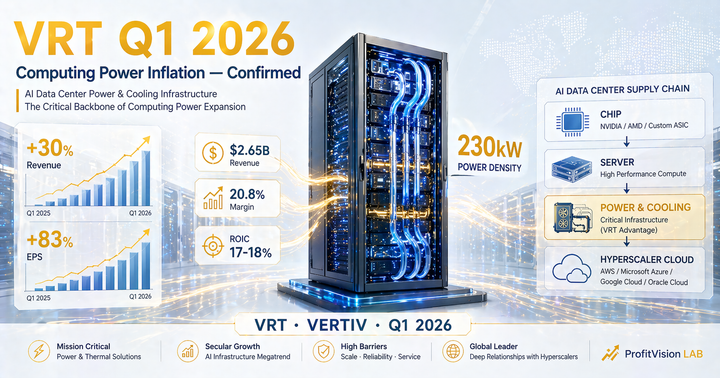

【算力通膨】:AI 基礎設施的非線性價值放大 — 解構 Vertiv (VRT)

在 2026 年 AI 投資賽局中,決定算力利潤的瓶頸是物理極限——電力與散熱。Vertiv (VRT) 透過功率密度、系統複雜度、風險轉移三大非線性放大效應,成為 Hyperscaler 的 SLA 責任外包對象,是 AI 基礎設施中最難被繞過的一檔。

一、流量在算力,利潤在「跑得動」

身為數位行銷人,我們知道「流量」是獲利的起點;但身為財會人,我更看重流量背後的「交付成本」與「穩定性」。

決定 AI 利潤能否入帳的瓶頸,其實是物理極限:電力與散熱。所有的 GPU 算力最終都要透過這兩道關口才能變現。沒電跑不起來,過熱會宕機,任何一個環節失守都等同於算力清零。

如果說 NVIDIA 是引擎,那 Vertiv (VRT) 就是確保這顆高溫引擎不會縮缸的「生命維持系統」。

這不是比喻,這是工程現實。資料中心的每一美元 Capex 投入,都必須有對應的電力基礎設施和冷卻能力來支撐。Vertiv 坐在這個不可或缺的位置上,而且隨著算力密度的飛升,它的價值正在以非線性的方式放大。

二、結構性跳升:工程暴力學下的數據重估

這不是一次漸進式的改進,而是一場工業級的斷代式跳躍。NVIDIA Rubin 世代帶來的規格衝擊,正在迫使整個資料中心基礎設施行業重新定價。

(舊標準約 30–40kW)

(相較前一代)

(暴力提升)

(無風扇,液冷唯一解)

關鍵的結構性變化:Rubin 世代採用「無風扇」設計,液冷從「可選方案」變成了「唯一解方」。VRT 的精密液冷分配單元(CDU)從可選配件變成了必備基礎設施。

傳統資料中心電力密度約 5–15kW/機櫃;H100 世代 40–60kW;GB200 NVL72 直接跳到 230kW——量級的躍升,不是線性外插,是斷層。每一次功率密度跳升,VRT 的每機櫃收費能力就跟著階梯式向上。

三、VRT 的護城河:它賣的是「責任外包」

站在 Hyperscaler(AWS、Azure、Google、Meta)的立場,「確保整機櫃 AI 設備不宕機」這件事,涉及兩個難以承受的代價:

- 極高的賠償風險:SLA 違約賠償,一次停機可能超過千萬美元

- 品牌信譽損失:雲端服務中斷的新聞一出,可能抵掉整年的市場行銷投入

因此他們選擇把這個「責任」外包給有能力承擔的專業廠商。VRT 正是市場上極少數同時具備「電力 + 液冷」完整整合能力,且「敢簽合約、能扛責任、能全球維運」的唯一選擇。

切換成本極高

VRT 與 NVIDIA 共同開發了 GB200 NVL72 的液冷參考架構,這個架構已成為業界標準。新客戶在部署 NVIDIA 最新系統時,幾乎沒有理由不選擇 VRT——這是一種「被生態系統選擇」的護城河。

四、投資解碼:什麼是「穩定 Beta 放大器」?

VRT 不創造預期差,它是跟著 AI 資本支出走的最強 Beta,而且是「放大型」的:

- 功率密度放大:機櫃功率每跳升一個量級,VRT 的單櫃價值(Content per Rack)就呈倍數增長。從 30kW 到 230kW,收費能力的增幅遠超 7 倍——因為設計複雜度和保固責任同步飛升。

- 系統複雜度放大:技術門檻越高,客戶對整合商的依賴度就越強。VRT 賣的是「整個系統能正常運作的保證」,這種整合者地位在技術跳升的節點只會越來越穩固。

- 風險轉移放大:AI 投資規模越大,停機成本越高,VRT 的「保險絲」價值就被放得越大。管理 $10 億 AI 算力的資料中心,願意為基礎設施穩定性支付的溢價,遠比 $1,000 萬時高出幾個數量級。

五、2026 結構性佈局:最難被繞過的一檔

2026 年的 AI 投資主軸,已從「誰的晶片最強」轉移到「算力能不能穩定交付」。VRT 的定位極為獨特:

- 不需要押注哪家 AI 公司最終勝出——只要有資料中心在建,VRT 就有生意

- 不需要依賴單一客戶——AWS、Azure、GCP、Meta 同時都是客戶

- 不需要押注技術路線——電力基礎設施是所有路線的共同需求

VRT 的定位是:「只要 AI 存在,它就能將這種存在穩定轉化為現金流。」

當然,這不是沒有風險的股票。高估值意味著市場已給予溢價;Hyperscaler Capex 若系統性收縮,訂單能見度雖有積壓訂單緩衝,但成長率仍會受壓。Schneider Electric 的追趕也值得持續追蹤。

但在當前 AI 資本支出週期仍向上的背景下,VRT 是研究宇宙裡最難被繞過的一檔。它不創造 AI 行情,但它確保 AI 行情能活下來。

Comments ()